Nächster Artikel

Safety Engineering

Generative KI als Lückenfüller

Künstliche Intelligenz (KI) eröffnet Unternehmen neue wirtschaftliche Chancen. Doch bei sicherheitskritischen Systemen wirft die Integration von KI erhebliche Sicherheitsbedenken auf. Dies erzeugt eine Lücke zwischen wirtschaftlichem Potential und Sicherheit, die Economic Safety Gap. Aber generative Künstliche Intelligenz (Generative AI, GenAI) kann helfen, sie zu schließen.

© iStock/Lucyna Koch

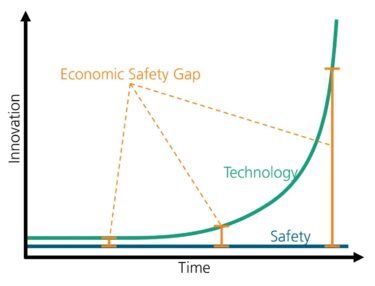

Safety Engineering ist heute ein unverzichtbarer Bestandteil der Produktentwicklung. Neue Technologien revolutionieren die Möglichkeiten, die uns zur Verfügung stehen, stellen jedoch auch bewährte Sicherheitsmethoden vor große Herausforderungen. Die sogenannte »Economic Safety Gap« entsteht, wenn neue Technologien (insbesondere KI-basierte Systeme) schneller entwickelt werden, als bestehende Sicherheitsmethoden sie bewerten, absichern und zertifizieren können.

Conference Paper, 2025

Mind the Economic Safety Gap

Publica.fraunhofer.deDiese wachsende Kluft zwischen technologischem Fortschritt und Sicherheitszertifizierung reißt ein potenziell gefährliches wirtschaftliches Loch. Innovative technologische Lösungen können nicht eingesetzt werden, weil die in bestehenden Normen und Vorschriften empfohlenen Analysen nicht oder nur mit großem Aufwand angewendet werden können. Dieser Aufwand treibt die Entwicklungskosten in die Höhe und macht viele potenzielle Anwendungen unwirtschaftlich. Eine wirksame Lösung dieses Dilemmas erfordert es, innovative Methoden im Sicherheitsingenieurwesen zu entwickeln und so Kosten zu reduzieren.

Generative KI als Lösung?

Eine vielversprechende Lösung stellt der Einsatz von generativer Künstlicher Intelligenz (GenAI) dar, einer Technologie, die auf Basis großer Datenmengen eigenständig neue Inhalte, Texte oder Designs erzeugen kann. Bekannte Beispiele sind Systeme wie ChatGPT, die aus natürlicher Sprache Informationen verarbeiten und neue, kontextbezogene Inhalte generieren.

Im Kontext des Safety Engineerings kann GenAI helfen, sicherheitsrelevante Prozesse zu beschleunigen und teilweise zu automatisieren. Ein prototypischer, GenAI-gestützter Sicherheitsassistent könnte zum Beispiel folgende Aufgaben übernehmen:

- Gefahrenanalyse und Risikobewertung: Automatisierung der Identifikation von Gefährdungen und der Abschätzung der damit verbundenen Risiken.

- Ableitung von Sicherheitsanforderungen: Effiziente Generierung von Anforderungen auf Basis von Systemarchitektur und Gefährdungen.

- Planung sicherheitsrelevanter Validierungs- und Verifizierungsmaßnahmen: Unterstützung bei der Planung von Tests, um die Erfüllung der definierten Sicherheitsanforderungen nachzuweisen.

Durch die Nutzung dieser Technologien können Sicherheitsingenieure wertvolle Ressourcen sparen und die Qualität ihrer Sicherheitsnachweise verbessern. Dies ermöglicht eine stärkere Fokussierung auf komplexe Anwendungen, die in der heutigen Zeit immer gefragter sind.

Zuverlässigkeit als Herausforderung

Trotz der vielversprechenden Ansätze bleiben mehrere Herausforderungen in der Forschung bestehen. Denn Sicherheitsanalysen bilden die Grundlage für die Entwicklung von sicherheitskritischen Systemen und sind daher sehr gründlich und zuverlässig durchzuführen. Wenn also GenAI für Sicherheitsanalysen zum Einsatz kommen soll, muss die Technologie weiter verbessert werden. Dazu gehört erstens die Entwicklung von Maßnahmen, mit denen Large Language Models (LLMs) verlässlicher funktionieren. Und zweites sollte auch das Nachtrainieren solcher Modelle mithilfe von domänenspezifischen Daten untersucht werden. Beide Ansätze ergänzen sich zu einem Software-Werkzeug, das speziell auf die Anforderungen des Safety Engineerings ausgelegt ist. Eine enge Zusammenarbeit zwischen KI-Expertinnen und -Experten sowie Sicherheitsfachleuten ist erforderlich, um die Technologie weiter zu verfeinern und Vertrauen in ihre Ergebnisse zu schaffen.

Während die technologischen Möglichkeiten exponentiell wachsen, schreiten die Entwicklungen im Bereich der Sicherheit nur langsam voran – die wachsende Kluft zwischen beiden Bereichen stellt ein wirtschaftliches Sicherheitsrisiko dar.

Ein Beispiel für einen vielversprechenden Ansatz ist die Entwicklung von maßgeschneiderten Retrieval Augmented Generation (RAG)-Systemen, die relevante Informationen effizient abrufen und für die automatisierte Analyse nutzbar machen können. Erste Ergebnisse zeigen, dass diese Ansätze die Qualität der identifizierten Gefährdungen und Sicherheitsanforderungen signifikant verbessern können.

Wenn die Economic Safety Gap schrumpft

Generative KI kann das Safety Engineering gezielt unterstützen, etwa durch automatisierte Risikoanalysen und die Ableitung von Sicherheitsanforderungen aus Systemarchitekturen und Daten. So lassen sich Sicherheitsprüfungen deutlich beschleunigen und die Economic Safety Gap verkleinern: Innovationen können schneller umgesetzt werden, ohne dass Sicherheitsstandards vernachlässigt werden. Entscheidend bleibt, dass die Ergebnisse verlässlich, nachvollziehbar und kontinuierlich validiert werden, um die Sicherheit technologischer Anwendungen auf ein neues Niveau zu heben.

Safe Intelligence Day 2026

GenAI steht auch im Mittelpunkt des Safe Intelligence Day 2026, der am 05. Februar 2026 am Fraunhofer IKS in München stattfinden wird. Erfahren Sie mehr darüber, welchen Mehrwert LLMs für verschiedene Anwendungen bringen können. Die Veranstaltung bietet außerdem die Möglichkeit, sich mit anderen Teilnehmenden sowie Wissenschaftlerinnen und Wissenschaftlern des Fraunhofer IKS über Chancen, Herausforderungen und Lösungsansätze auszutauschen.

In Anbetracht der sich ständig weiterentwickelnden technologischen Landschaft ist es daher unerlässlich, dass das Sicherheitsingenieurwesen nicht nur Schritt hält, sondern auch proaktiv neue Methoden und Werkzeuge entwickelt, um die Sicherheit der zukünftigen Technologien zu gewährleisten. Nur so kann die wirtschaftliche Sicherheitslücke geschlossen und die Innovationskraft in sicherheitskritischen Anwendungen gesichert werden.